"L’IA amplifie l’intelligence humaine comme la machine amplifie la force", juge l’un de ses pères, Yann le Cun

ENTRETIEN - Faut-il avoir peur des intelligences artificielles ? Vont-elles bouleverser nos vies, nos métiers, nos sociétés ? L'un des chercheurs à l'origine de leurs développement, Yann Le Cun, répond aux questions de Léa Salamé...

Il est l’un des hommes clés de l'invention de l’intelligence artificielle. Le Français Yann Le Cun vit aux États-Unis depuis 30 ans, a enseigné à la New York University et au Collège de France, a remporté le prestigieux prix Turing, Nobel de l’informatique, en 2018, et dirige aujourd’hui le laboratoire d'intelligence artificielle de Meta, la maison mère de Facebook. Alors que les intelligences artificielles génératives semblent s’apprêter à bouleverser nos vies, le chercheur n'y voit pas une menace. "La technologie crée de nouveaux métiers et en supprime d'autres", affirme-t-il, estimant que le problème réside surtout dans la façon dont nous allons nous adapter. Entretien avec l’une des sommités mondiales dans ce domaine.

FRANCE INTER : Comment le jeune thésard que vous étiez dans les années 80 a-t-il été attiré par le pouvoir des machines, par leur intelligence et les balbutiements de ce qu’est aujourd’hui l'intelligence artificielle ?

YANN LE CUN : "Pour moi, le mystère de l'intelligence était l’une des grandes questions scientifiques du moment, et puis j'avais un peu la fibre de l'ingénieur. Donc la logique était effectivement d'essayer de construire des machines intelligentes pour essayer de comprendre l'intelligence en général, l'intelligence humaine, l'intelligence animale et peut-être faire des machines intelligentes."

Quels sont, selon vous, les effets bénéfiques de l'intelligence artificielle aujourd'hui ?

"Aujourd’hui, par exemple, toutes les voitures qui sortent des usines en Europe, grâce à une loi européenne, doivent avoir un système automatique de détection des collisions, l’AEBS, "automatic emergency breaking system", en anglais. Ce sont ces systèmes qui permettent à la voiture de freiner automatiquement, qui sauvent des vies, réduisent les collisions d'environ 40 %. Voilà une application très concrète, avec la vision par ordinateur et la reconnaissance des formes, basée dans une très large part sur une de mes inventions à la fin des années 80, qui s'appelle le réseau convolutif. On voit aussi ça sur nos téléphones portables, des systèmes qui identifient une espèce de plante à partir d'une photo de la feuille. Les techniques remontent à la fin des années 80, début des années 90. Mais ce n'est que récemment qu'on a eu assez de données pour les entraîner et d'ordinateurs assez puissants pour les faire tourner.

En ce moment, il y a aussi beaucoup d'applications qui sont testées et partiellement déployées dans le domaine de la santé, comme des systèmes de détection de tumeurs dans les mammographies… Ce sont des technologies qui ont été développées en collaboration par FAIR, le laboratoire de recherche en IA de Meta et par New York University, l'université où j'enseigne.

Enfin, au-delà de l'imagerie médicale assistée par ordinateur, qui est un énorme sujet en ce moment, il y a aussi beaucoup de promesses dans le domaine de la découverte de nouveaux médicaments, grâce à l'utilisation de l'intelligence artificielle pour, par exemple, prédire la conformation des protéines et savoir comment faire la conception d'une molécule qui va se coller à un endroit particulier sur une protéine et avoir un effet biologique."

"Amplifier l'intelligence humaine, comme les machines amplifient la force physique"

Vous dites que l'intelligence artificielle va vraiment entrer dans nos vies quotidiennes dans un avenir plus ou moins lointain, sous la forme d'assistants virtuels qui seront d'abord dans nos smartphones et qui, peut-être un jour, seront dans d'autres objets du quotidien, comme les lunettes par exemple. En quoi ce monde virtuel, qui viendrait se superposer au monde réel, sera-t-il un progrès à vos yeux ?

"La première chose, c'est peut-être qu'on peut se demander : "Est-ce qu'un jour, il y aura des machines aussi intelligentes que les humains dans tous les domaines où les humains sont intelligents ?". Et la réponse à ça est : "Absolument, oui, il n'y a aucun doute là-dessus." Ce n'est pas encore le cas. On en est encore assez loin, malgré les progrès récents et les systèmes de dialogue comme ChatGPT qui sont devenus disponibles pour le public. D’ailleurs, on a l'impression que ces systèmes sont intelligents, mais en fait, ils n'ont pas le type d'intelligence qu'on constate chez les humains. Ils sont capables de manipuler la langue et ça nous donne l'impression qu'ils sont intelligents, mais c'est une intelligence très superficielle."

Mais vous dites qu'à terme, la machine sera supérieurement intelligente à l'intelligence humaine…

"Oui, ça ne fait aucun doute. Maintenant, reste à savoir quelles seront les conséquences sur la société, etc. Est-ce que c'est potentiellement bénéfique ? La réponse est oui. Est-ce que c'est potentiellement dangereux ? Probablement. Est-ce qu’on va pouvoir réduire certains dangers au minimum, comme celui de prendre l'avion ? La réponse est très probablement oui aussi. Alors, est ce qu'il faut en avoir peur ? Non, en ce sens que l'intelligence artificielle est un moyen d'amplifier l'intelligence humaine, de même que les machines sont un moyen d'amplifier la force physique, et qu’il ne faut pas avoir peur de l'intelligence artificielle. Il faut voir ça, au contraire, comme une certaine nouvelle renaissance, possiblement un nouveau départ pour l'Humanité, parce que le progrès de l'Humanité est limité par l'intelligence de l'humain."

À lire aussi : Prompt, IA forte, Deeplearning... voici notre lexique pour tout comprendre à l'intelligence artificielle

"La technologie déplace des métiers depuis des millénaires"

Pourtant, ça fait peur, surtout quand on apprend que la banque d'affaires Goldman Sachs annonce que l'intelligence artificielle pourrait menacer jusqu'à 300 millions d'emplois dans le monde. Que répondez-vous ?

"Cette histoire que la technologie déplace des métiers, c'est vrai depuis le départ du développement technologique, depuis des millénaires et a fortiori depuis la révolution industrielle à la fin du XIX? siècle. Par exemple, à l'époque, la plupart de la population française travaillait à la production de nourriture, dans les champs, dans les fermes, etc. Maintenant, c'est entre 1 et 2 % de la population. Donc il y a eu un déplacement des métiers, dû au progrès technologique. On peut aussi essayer de se projeter 20 ans en arrière et de se demander : "Mais que voulait dire à cette époque être youtubeur ou être influenceur sur Instagram ?" C'est un métier qui n'existait pas. La technologie crée de nouveaux métiers et en supprime d'autres, bien sûr.

Donc le sujet est de savoir en combien de temps. Est-ce que la transition va se faire très rapidement ou à un rythme qui va permettre aux gens de se reformer, de s'entraîner aux nouvelles technologies ? On a vu ça aussi avec l'avènement d'Internet, avec l'avènement des ordinateurs, avec tout un tas de métiers des années 60-70 qui n'existent plus à cause du progrès de la technologie. Ce n'est pas un phénomène nouveau et l'IA n'est pas bien différente des autres transformations technologiques. Ce que les économistes nous disent, c'est que la rapidité avec laquelle une technologie entre et pénètre la société et l'économie en particulier est limitée par la capacité des gens à apprendre à l'utiliser. C'était vrai pour l'ordinateur, et en général, ça prend 10 ou 20 ans, plutôt 20 ans. Donc la chose la plus importante, c'est de savoir, si on est jeune, quel genre d'études faire et, si on est moins jeune, si on doit se reformer, à utiliser les nouvelles technologies."

Quelles études faire, quelle est votre réponse ?

"Les métiers scientifiques ou techniques ne vont pas disparaître, même si on a des machines qui peuvent nous aider à écrire des programmes plus rapidement qui existent déjà, ou faire de l'aide au design. Ce que ces machines vont permettre, c'est à une catégorie plus large de personnes d'être créatives, au niveau artistique ou technique, et donc entraîner une espèce de démocratisation de la création. Mais les métiers de la création, qu'elle soit artistique, littéraire, scientifique ou technique, ne vont pas disparaître. Simplement, plus de gens vont être capables de créer."

Une autre critique qui revient souvent, c'est la peur que l'intelligence artificielle ne devienne un outil anti-démocratique. On l'a vu avec notamment, ces derniers jours, ces fausses images générées par des IA. Comment lutte-t-on contre ça ? Doit-il y avoir une éthique de l'intelligence artificielle ?

"Bien sûr, il y a des problèmes d'éthique au niveau de la société, des problèmes de réglementation. Il y a donc la nécessité d'avoir de nouvelles technologies qui permettent de tracer l'origine des contenus. Le pape en doudoune, c'était un peu évident que c'était faux, ça ne porte pas beaucoup à conséquence, mais ça aurait été bien de savoir que ça a été effectivement produit par un système. Ceci dit, ce genre d'images aurait très bien pu être produit, il y a une dizaine d'années avec des outils de création d'images comme Photoshop et autres, donc ce n'est pas nouveau.

Par ailleurs, les gens ne sont pas bêtes et les jeunes qui ont grandi avec l'Internet savent prendre tout ce qui sort de l'Internet et essayer d'en tracer l'origine. Tout le monde n'a pas le temps de faire ça ni la présence d'esprit de le faire. Mais je pense qu'à terme, les gens vont devenir de plus en plus sceptiques et de plus en plus à même de tracer l'origine des informations."

Ce serait le bon scénario… L'autre, ce serait qu'on soit noyé sous des fausses informations et qu'on ne sache plus du tout distinguer ce qui est vrai et ce qui est faux.

"Oui, mais vous savez, c'est un peu comme les spams dans les mails : on reçoit probablement beaucoup plus de spams que de vrais mails. Mais, aujourd’hui, les systèmes de mail filtrent automatiquement, éliminent les faux comptes, etc. Il y a eu le même problème sur tous les réseaux sociaux. Sur Facebook, par exemple, il y a une grosse équipe qui travaille sur l'élimination de faux comptes, sur la désinformation dangereuse et, là, l'intelligence artificielle n'est pas le problème, mais bien la solution.

Après l’ingérence, en 2016, pour l'élection présidentielle américaine, Facebook a immédiatement mis en place des mesures pour que l'histoire ne se répète pas, notamment pour l'élection présidentielle de 2017 en France et les élections générales allemandes la même année. Il n'y a pas eu de problème, grâce à ces mesures qui ont été prises. À chaque fois qu'il y a un problème comme ça qui surgit, il y a une contre-mesure mise en place pour corriger. Ce que les gens ne réalisent pas, par exemple, c'est qu'une des plus grosses applications de l'intelligence artificielle en ce moment, c'est la modération de contenu dans les réseaux sociaux, que ce soit Facebook, Instagram, YouTube, Twitter... Des techniques très sophistiquées permettent de supprimer les discours haineux, les contenus illégaux (propagande terroriste, l'exploitation des enfants, la pédophilie). Mais c'est un petit peu derrière le rideau, les gens ne le voient pas. Sur Facebook, le pourcentage de contenus haineux est de l'ordre de 0,02 %, aux dernières estimations. Plus de 90 % sont supprimés automatiquement par des systèmes d'IA, avant que qui que ce soit ne les voient. Et ceux qui passent à travers le filet sont bien sûr étiquetés par les utilisateurs et examinés manuellement, et ceci dans plusieurs centaines de langues. Donc c'est un problème qui a fait d'énormes progrès ces dernières années grâce à la recherche en IA. Le même pourcentage, il y a quatre ou cinq ans, était plutôt de l'ordre de 30 %."

ChatGPT, "de la bonne ingénierie" mais "pas révolutionnaire"

ChatGPT, ce logiciel dont tout le monde parle, est-il la "plus grande révolution technologique depuis les années 80" comme l’a dit Bill Gates ? Vous vous montrez beaucoup plus sceptique…

"Oui, c'est un bon produit qui a l'avantage d'avoir été mis dans les mains des utilisateurs et du public. C'est de la bonne ingénierie, c'est très bien ficelé, mais au niveau de la science et la technologie sous-jacente, ce n'est pas du tout révolutionnaire, non. Pour des gens comme moi et mes collègues qui voient ça des tranchées, c'est une évolution un petit peu naturelle. Il y a effectivement des capacités qu'on voit émerger dans ces systèmes qui sont extrêmement surprenantes, mais qui n'ont pas été révélées pour nous par GPT, qui datent d’il y a plusieurs années. Donc ce qu'on constate, c'est qu'on peut entraîner ces systèmes de "deep learning" (qui ont des réseaux de neurones artificiels de très grande taille et des milliards de paramètres, l'équivalent des connexions entre les neurones dans le cerveau), sur des quantités de texte absolument énormes, de l'ordre de 1000 milliards de mots, soit la totalité des textes qui résident sur Internet. Et ils finissent par apprendre certainement à manier la langue, mais aussi à faire un certain niveau de raisonnement et en tout cas d'adapter des choses qu'ils ont lues à la situation qu'on leur demande.

Mais le principe sur lequel ils sont basés, c'est purement et simplement d’essayer de prédire la continuation d'un texte. Ils essaient de prédire les mots qui seraient les plus probables dans le corpus de textes dans lequel ils ont été entraînés. Bien sûr, il y a beaucoup de connaissances humaines, présentes sur Internet, mais elles sont très superficielles et ça ne comprend pas, par exemple, la connaissance du monde physique, du monde réel. Donc ces systèmes, d'une certaine manière, ont beaucoup moins de connaissances du monde réel… Que votre chat."

À réécouter : ChatGPT, Midjourney : l'intelligence artificielle a déjà tout changé pour eux

Le zoom de la rédaction

ÉCOUTER PLUS TARD

4 min

Le développement de ChatGPT inquiète tout de même. L'Italie est devenue vendredi le premier pays à le bloquer provisoirement. Et puis, il y a eu cette lettre ouverte, il y a quinze jours, d'un millier d'experts du secteur dont Elon Musk, qui a appelé à suspendre pendant six mois les recherches sur les nouveaux systèmes plus puissants, en estimant qu'ils étaient dangereux pour l'Humanité. Vous avez comparé les signataires de cette lettre à l'Église catholique qui, au XV? siècle, demandaient un moratoire sur l'utilisation de l'imprimerie…

"D'abord, effectivement, l'Italie a interdit l'utilisation de GPT, pas du tout pour les conséquences des systèmes d'IA, mais plutôt pour des raisons de protection des données privées. Les gens interagissent avec ces systèmes, leurs donnent quelquefois des informations très personnelles et, derrière ça, l'entreprise qui produit le système réutilise ces données pour ajuster le système pour que la prochaine fois qu'on l'utilise, la réponse soit un petit peu plus correcte et appropriée.

Maintenant, pour la lettre, effectivement, à chaque fois qu'une nouvelle technologie, particulièrement une technologie de communication, est apparue, il y a eu toujours eu une réaction, imaginant des dangers qui, quelquefois étaient réels, quelquefois n'étaient pas si réels que ça. La question, c'est : "Quel est le compromis entre les risques et les avantages ?" Pour l'imprimerie en particulier, l'Église catholique n'aimait pas du tout l'idée que les gens puissent lire la Bible eux-mêmes et n'aient plus à parler aux prêtres. Ils ont dit que ça allait détruire la société et, en fait, ils ont eu absolument raison : ça a détruit d'une certaine manière la chrétienté en Europe, en créant les mouvements protestants. D'un autre côté, ça a aussi permis le siècle des Lumières, le rationalisme, la science, la philosophie et la démocratie. Donc, l'invention de l'imprimerie a contribué à une nouvelle renaissance, une nouvelle phase dans le développement humain. L'Empire ottoman à la même époque, qui a interdit l'utilisation de l'imprimerie, a contribué à son déclin alors qu'il était dominant pendant le Moyen-Âge, sur le plan des sciences et technologies. Donc il faut se méfier, quand une nouvelle technologie de communication apparaît, qu'elle rend les gens plus intelligents, soit directement, soit en multipliant leur intelligence ou leur savoir. On prend un énorme risque à limiter l'utilisation de ces technologies…"

Mais faut-il tout de même réguler ? L'Union européenne s'apprête à le faire… Comment regardez-vous ce futur règlement ?

"Ça ne fait aucun doute qu'il faille réglementer les applications et les utilisations, le déploiement de l’intelligence artificielle. Par exemple, si on utilise un système comme outil de diagnostic médical ou pilote automatique dans les voitures, il est évident qu'il faut les tester avant de les mettre sur le marché. Parce qu'ils risquent de mettre des vies en danger. Maintenant, est-ce qu'il faut aussi limiter la recherche et le développement ? C'est là que je suis en désaccord avec les signataires de cette lettre, de ce moratoire de six mois. D'abord, parce que je pense que c'est une très mauvaise idée, une espèce de nouvel obscurantisme. En fait, il faut plutôt accélérer les recherches scientifiques, si on veut pouvoir construire des systèmes d'IA bénéfiques pour l'Humanité en général. Et le deuxième point, c'est que c’est évidemment complètement irréaliste de dire aux gens d’arrêter la recherche pendant six mois. D'abord, ça ne servira à rien et personne ne va le faire. Ou, si quelques-uns le font, ce ne sont pas ceux qui ont le plus de chance, de mal utiliser l'IA qui vont arrêter."

Des perspectives "très prometteuses" en Europe et en France

Voilà 30 ans que vous habitez aux États-Unis. Pourquoi n'avez-vous pas fait carrière en France ?

"Il y a deux choses qui attirent un chercheur. Les opportunités de carrière, le fait qu'à l'époque où je suis parti, la recherche industrielle en France était relativement appliquée et à court terme et qu’il est difficile de travailler dans le domaine des sciences de l'information, de l'informatique, dans un laboratoire industriel avec des ambitions de à long terme, ce n'était pas dans les habitudes. Il y avait ce genre d'opportunités aux États-Unis, j'ai travaillé aux laboratoires Bell, qui appartenaient à la compagnie de téléphone AT&T, chez qui une grande partie des technologies utilisées aujourd'hui ont été inventées, y compris les méthodes de "deep learning" dont je parlais précédemment, quand j'ai commencé à travailler dessus dans les années 80-90.

Mais il y a aussi le problème de la recherche académique dans les universités ou les laboratoires publics. La situation n'a pas énormément évolué en France, en ce sens que les chercheurs du public ne sont pas très bien payés, certainement beaucoup moins qu’aux États-Unis et en Suisse. C'est un problème qui est général à l'Europe."

La France produit des talents, mais elle n'arrive pas à les garder ?

"Ce qui change un petit peu la donne en ce moment, c'est que les grandes entreprises de la tech américaine ont des laboratoires établis en France ou en Europe, avec des perspectives de carrière très prometteuses. J’en ai créé un qui s'appelle FAIR Paris, pour "Facebook Artificial Intelligence Research", qui est une branche parisienne du laboratoire de recherche en IA de Méta, avec une centaine de personnes et qui est vraiment à la pointe. On y forme aussi des étudiants en doctorat, il y en a une trentaine pour l'instant, et une dizaine par an sortent de ces labos et essaiment la connaissance dans l'écosystème français. Ces doctorats sont faits en collaboration avec des universités ou des laboratoires publics et contribuent à populariser le domaine et à attirer des jeunes talents dans le domaine de la recherche en IA, qui auparavant auraient fait de la finance ou quelque chose comme ça.

Par ailleurs, il y a un système que mes collègues viennent de distribuer et qui s'appelle LLAMA, c’est une sorte de GPT ‘open source’, c’est-à-dire utilisable par tous les chercheurs pour essayer d'examiner comment ça fonctionne. Sur les quatorze auteurs de ce systèmes, onze sont à Paris."

Quelle est la découverte dont vous êtes le plus fier ?

"Certainement ces réseaux convolutifs, qui sont utilisés pour permettre aux machines de voir, interpréter les images et la vidéo, invention qui remonte à la fin des années 80. Mon nom est attaché à cette découverte, avec des collaborateurs, qui a complètement révolutionné l'IA ces dix dernières années et qui a contribué à l'essor de l'IA qu'on connaît aujourd'hui."

Un jour, mon assistant virtuel posera-t-il des questions auxquelles votre assistant virtuel répondra ?

"Non, je pense que ce genre d'interview se fera toujours en personne. En revanche, il y a un futur dans 10 ou 15 ans peut-être, ou un peu plus longtemps, dans lequel on ne se promènera plus avec des smartphones dans nos poches, mais on aura des lunettes de réalité augmentée, qui pourront superposer des images virtuelles sur le monde réel, afficher des informations, permettront de faire des choses pour lesquelles la technologie existe déjà, comme la traduction simultanée. Donc, par exemple, on pourrait parler à quelqu'un qui parle une autre langue et les sous-titres s'afficheraient automatiquement dans nos lunettes.

Ce qui est aussi possible, c'est qu'on interagira avec ces nouveaux systèmes par l'intermédiaire de la voix, par l'intermédiaire de nouvelles interfaces, comme des bracelets qu'on pourra porter autour du bras et qui mesurent les courants électriques des nerfs. Qui permettraient par exemple de pointer ou de taper au clavier avec les mains dans les poches.

Mais surtout, on interagira avec des assistants virtuels intelligents qui, à un certain moment auront une intelligence similaire à l'intelligence humaine, peut-être supérieure dans certains domaines et qui pourront nous aider dans nos vies de tous les jours. Ce serait comme avoir un meilleur ami, peut-être plus intelligent que vous, mais à votre service, tout le temps présent, qui vous aide dans votre vie de tous les jours et qui, par exemple, vous permet de vous concentrer sur les choses qui vous intéressent et ne pas avoir à passer une heure au téléphone pour parler à votre plombier ou à votre Sécurité sociale."

Le 12/04/2023

Source web par : radiofrance

Les tags en relation

Les articles en relation

Génération AI : 1.000 PME marocaines adoptent l’IA

La Confédération générale des entreprises du Maroc (CGEM) a lancé, en partenariat avec la Banque européenne pour la reconstruction et le développement (B...

Trump impose des droits de douane réciproques

Le président américain Donald Trump a annoncé jeudi son intention d’instaurer des "droits de douane réciproques", visant à corriger les déséquilibres d...

Le Maroc et les États-Unis Lancent un Groupe des Amis sur l'IA pour le Développement Durable

Vendredi à New York, l’ambassadeur représentant permanent du Maroc auprès de l’ONU, Omar Hilale, et son homologue des États-Unis, Linda Thomas-Greenfiel...

Conseil de la Concurrence : le développement durable, un catalyseur pour l’économie (VIDEO)

Le Conseil de la Concurrence a organisé une conférence internationale intitulée « Le développement durable : défi concurrentiel et relais de croissance »...

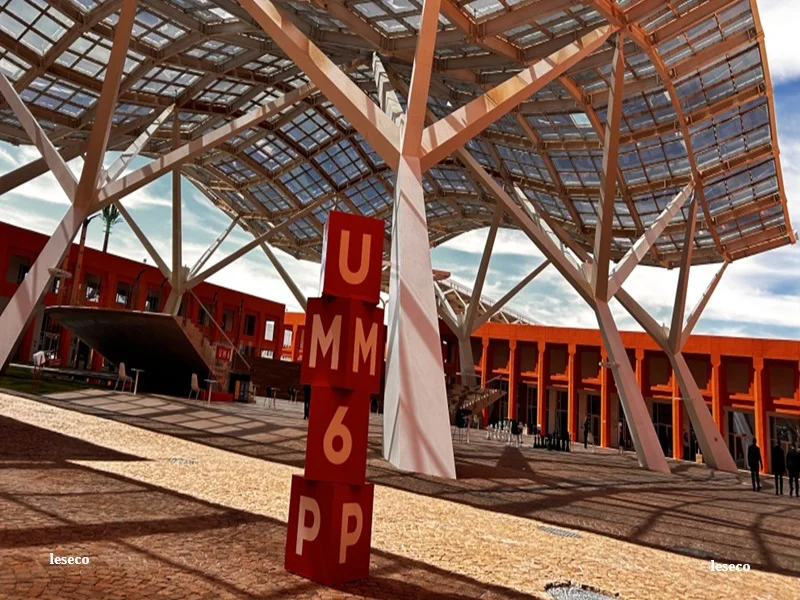

Ai Movement : Le Centre de l'Université Mohammed VI Polytechnique de Rabat, Premier Hub Africain d'

Le centre d'excellence de l’Université Mohammed VI Polytechnique de Rabat, « Ai Movement », vise à promouvoir l'expertise marocaine et africaine e...

Relations commerciales USA-UE : un équilibre plus complexe

Un excédent commercial européen à relativiser Donald Trump accuse régulièrement l’Union européenne (UE) d’abuser des États-Unis en accumulant des ...

GITEX 2025 : Concentrix propulse le digital marocain

Du 14 au 16 avril 2025, Marrakech devient la capitale numérique du continent avec la 3e édition du GITEX Africa, réunissant 45 000 participants, 1 400 exposa...

Quand l’Efficacité à la Elon Musk Inspire la Gouvernance : Un Modèle pour le Maroc ?

Et si Elon Musk, avec sa philosophie révolutionnaire d’efficacité, devenait un modèle pour le gouvernement Akhannouch ? Imaginons un instant un scénario ...

Intelligence artificielle générative : révolution technologique ou nouvelle bulle financière ?

Le boom de l’intelligence artificielle générative, qui attire des investissements massifs, suscite des interrogations quant à la possibilité d’une nouve...

Suisse : le principal fonds de garantie tourisme va assurer les risques entre professionnels

Comme en Allemagne, le Fonds de Garantie de la branche suisse du Voyage va changer les règles pour ses adhérents et pour les consommateurs, dès le 1er janvie...

Maroc-France : Un partenariat stratégique pour l'agriculture digitale

Dans le cadre de sa participation en tant que pays à l'honneur au Salon International de l’Agriculture (SIA) de Paris (22 février - 2 mars), le Maroc a ...

UM6P et FMI : Conference MENA 2026 a Rabat

L’Université Mohammed VI Polytechnique coorganisera avec le Fonds monétaire international la Conférence de recherche FMI MENA 2026, prévue les 29 et 30 ju...

samedi 15 avril 2023

samedi 15 avril 2023 0

0

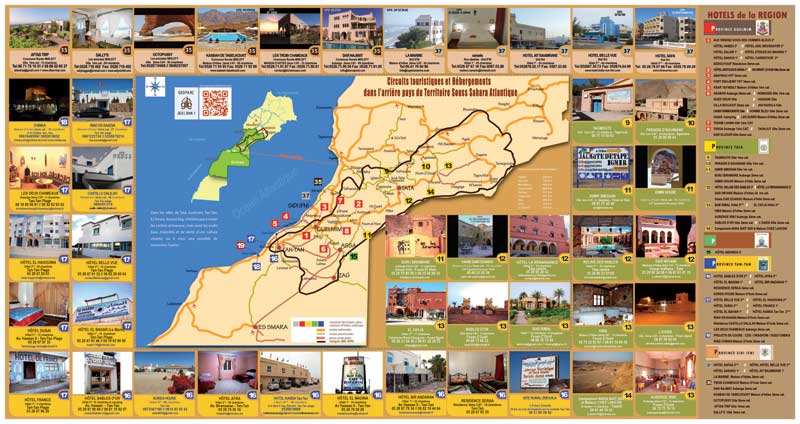

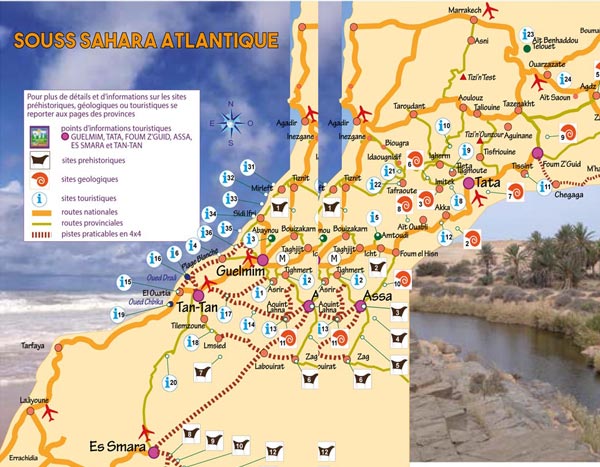

Découvrir notre région

Découvrir notre région